Kto korzysta z Google Duo, ten może mieć powody do radości. Wszyscy inni mogą potraktować tego newsa z zaciekawieniem, bowiem istnieje już sztuczna inteligencja, która poprawi Twój głos. Jeśli jednak marzą Ci się zdolności wokalne Quebonafide albo Edyty Górniak to rozczaruję cię, aż tak Machine Learning z Google Duo nie zmieni Twoich możliwości. Na pewno jednak sprawi, że osoba, z którą rozmawiasz, usłyszy Cię znacznie lepiej. Wszystko dzięki pracy naukowców z DeepMind.

Kim są?

DeepMind to jedna z firm córek w zawiłej konstrukcji koncernu Alphabet, pod którego skrzydłami jest też Google. Zespół DeepMind to naukowcy, inżynierzy i eksperci w dziedzinie Artificial Intelligence i Machine Learning, którzy pracują nad unowocześnieniem obecnych rozwiązań o szerokim wachlarzu możliwości i wprowadzaniem nowych, nowatorskich pomysłów.

Co zrobili?

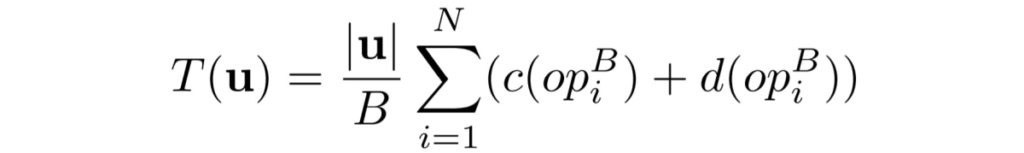

Stworzyli nową technologię do poprawy jakości dźwięku, które znacząco poprawi jakość rozmów. Technologia została nazwana WaveNetEQ i jest oparta na innym wynalazku, który nazywa się WaveRNN. Choć kwestie techniczne nie są mi obce nie będę się zagłębiał w tajniki tych rozwiązań, bo już same równania mnie przerażają, ale zachęcam do przeczytania artykułu naukowego na ten temat.

Gdzie leży problem?

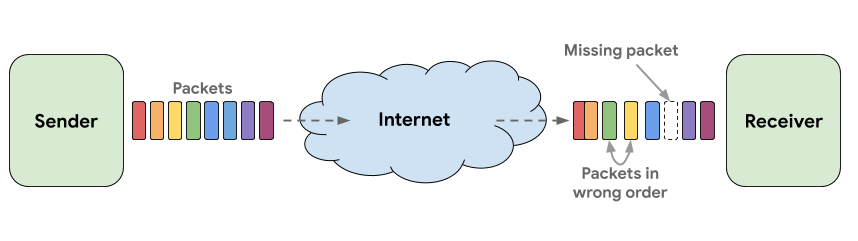

W zakłóceniach dźwięku, które nie są obce chyba żadnemu użytkownikowi internetowych komunikatorów głosowych. Google twierdzi, że 99% połączeń wykonywanych przy pomocy aplikacji Duo, wykazuje utratę wysyłanych pomiędzy użytkownikami pakietów dźwiękowych: 20% połączeń traci 3% danych głosowych i 10% połączeń traci ponad 8% danych.

O ile z małymi utratami istniejące oprogramowanie potrafi sobie poradzić, o tyle specjaliści z DeepMind mówią, że przy utratach rzędu 60 ms powstaje poważny problem. To wtedy powstaje charakterystyczny robotyczny dźwięk albo doświadczamy specyficznego zacinania się dźwięku lub jego powtarzalności.

Jak DeepMind sobie z tym poradzili?

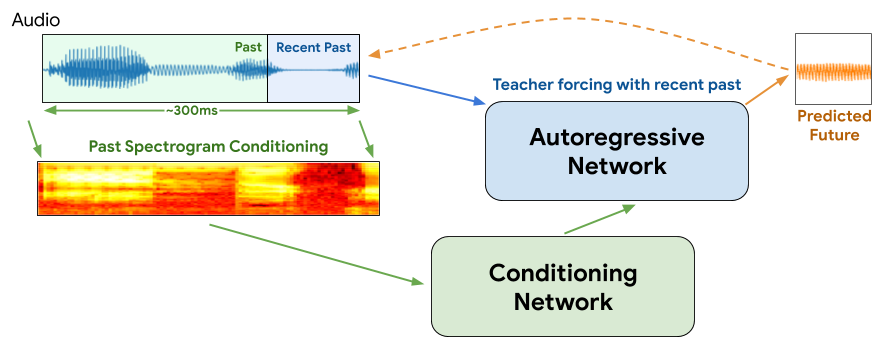

W oparciu o sieć neuronową (o której możesz też przeczytać tutaj) stworzono wspomniane wcześniej WaveNetEQ, które następnie przeszkolono na ponad setce użytkowników w 48 różnych językach. Powstała technologia nauczyła się (Machine Learning) jak zastępować utracone dane, by je zastępować w czasie rzeczywistym tak, by dźwięk wydawał się znacznie bardziej naturalny.

Niestety, naukowcy i inżynierzy spotkali szereg utrudnień. Bodajże największym jest to, że całość tego skomplikowanego procesu musi się dokonywać na urządzeniu, ponieważ połączenia z Google Duo są kompleksowo szyfrowane.

Na szczęście współczesne telefony potrafią sobie radzić z takimi procesami. Google chwali się, że tak ulepszone Duo działa już na modelach Pixel 4. Innym problemem jest długość występującego zakłócenia. Obecnie, po wielu pracach optymalizacyjnych, technologia jest w stanie naprawić 120 ms utraty dźwięku.

Ogromny PLUS

Trzeba przyznać, że naukowcom udało się zrobić coś, co zwiastuje pozytywne myślenie o przyszłości. Zamiast np. zastępować użytkownika (w tym jego głos) sprytną technologią, wymyślono coś na kształt protezy, która daje poczucie interakcji z żywym organizmem, a nie sztucznym tworem (chociażby był bliski ideałowi). Machine Learning ma ogromny potencjał i należy bacznie się przyglądać co laboratoria takie jak DeepMind jeszcze wymyślą.