Jedna z firm Elona Muska, OpenAI, pokazała światu nowy model Sztucznej Inteligencji, nazwany Jukebox (po polsku – szafa grająca). Potrafi on tworzyć muzykę od zera, jak również układać (i śpiewać) do niej słowa. A najlepsze jest to, że możemy posłuchać tych utworów już dzisiaj.

Do wyboru, do koloru

Dlaczego programiści z firmy OpenAI postanowili zająć się muzyką? Jak sami piszą na swoim blogu, ponieważ jest to trudne.

Na stronie Jukebox można posłuchać już kilku kawałków. Pogrupowane są w następujące kategorie (bazujące na formie trenowania modelu):

- oryginalne utwory z nowym tekstem,

- oryginalne utwory z tekstem innych piosenek,

- utwory bazujące na 12 sekundach istniejących piosenek,

- zabawne piosenki, czyli pomieszane style.

Jak Jukebox został stworzony?

Amerykańscy badacze podeszli do problemu inaczej niż dotychczas. Zamiast trenowania modelu na podstawie cyfrowych syntezatorów muzycznych, np. ucząc model układania nut na linii czasu, do jego trenowania zostały użyte już istniejące piosenki. Dzięki temu AI mogło również nauczyć się układać słowa do swoich utworów. Jukebox uczył się więc muzyki jak człowiek – przez słuchanie już istniejących kawałków.

Zagłębiając się jeszcze bardziej, możemy zauważyć, że model nie był trenowany na nieprzetworzonych utworach. Najpierw użyto splotowych sieci neuronowych (convolutional neural networks), aby skompresować plik audio. Pozwalało to na szybszą pracę modelu, gdyż nie musiał przetwarzać tak wielu próbek na sekundę (oryginalny utwór ma aż 44000, a przetworzony 344).

:format(webp):no_upscale()/cdn.vox-cdn.com/uploads/chorus_asset/file/19935907/Screen_Shot_2020_04_30_at_1.55.44_PM.png)

Następnie model tworzył nowy, skompresowany utwór, na podstawie tego wprowadzonego, a przez różne transformatory mógł zwiększyć jego próbkowanie z powrotem do 44000. Warto zaznaczyć, że Jukebox to nie jest pierwsza próba stworzenia modelu Sztucznej Inteligencji, który komponuje muzykę. OpenAI wypuściło też program MuseSet, który jednak nie umiał tworzyć własnych słów do piosenek.

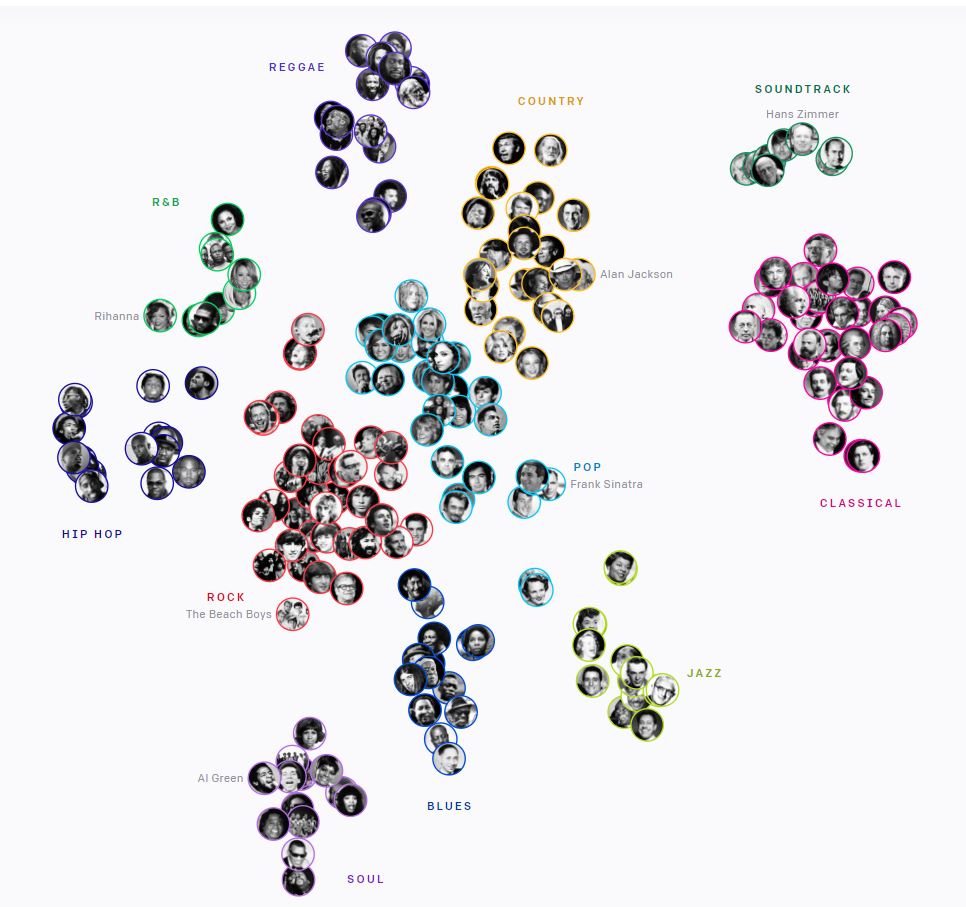

Model AI, na którym bazuje Jukebox, został przetrenowany na 1,2 mln utworów, z których połowa miała słowa po angielsku, a także posługiwano się danymi ze strony LyricWiki (dzięki czemu model może łatwiej klasyfikować utwory do poszczególnych gatunków).

Jak piszą sami twórcy, Jukebox również posiada limity:

Chociaż Jukebox to duży krok naprzód, jeśli chodzi o jakość muzyki, spójność i długość utworu, a także możliwość dostosowywania muzyki pod względem gatunku, artysty i słów, wiele mu brakuje do utworów tworzonych przez człowieka. Na przykład, Jukebox nie tworzy powtarzalnych struktur muzycznych, takich jak refreny.

„While Jukebox represents a step forward in musical quality, coherence, length of audio sample, and ability to condition on artist, genre, and lyrics, there is a significant gap between these generations and human-created music. For example, […] we do not hear familiar larger musical structures such as choruses that repeat.”

Czy to legalne?

Chwila, chwila… Jak to legalne? Przecież Jukebox tworzy oryginalną muzykę…

Nie do końca. Ten model używa audio z wielu utworów, przez co części jego własnych kreacji mogą zawierać melodie lub słowa, które są chronione prawami autorskimi. A to już nie jest łatwa bariera do przejścia. Raper Jay-Z jeszcze w tym tygodniu próbował zdjąć z serwisu YouTube nagranie wykorzystujące podobny mechanizm (syntetycznie podrobiło jego głos).

Podsumowując, jest to na pewno wielki krok w stronę rozwoju AI. W końcu śpiew nie brzmi jak tekst wpisany w Tłumacza Google. I ponieważ Jukebox to nowa technologia, będzie musiała przejść przez wiele, dotychczas niespotykanych, barier.

Na razie, możemy słuchać ile chcemy, klikając tutaj.