W dzisiejszych czasach rozwijająca się technologia przynosi wiele korzyści, ale także niesie ze sobą nowe zagrożenia. Jednym z takich zagrożeń są ataki typu MitM (man-in-the-middle), które polegają na przechwytywaniu ruchu danych między dwiema stronami — w tym przypadku między robotem a jego prawowitymi kontrolerami. Celem tych złośliwych ataków jest zakłócenie działania bezzałogowych pojazdów wojskowych, modyfikowanie przesyłanych instrukcji, a nawet przejęcie kontroli nad nimi.

Algorytm AI do wykrywania ataków MitM

Profesor Anthony Finn, uczestniczący w badaniach, zwraca uwagę, że system operacyjny robota (ROS) jest niezwykle podatny na naruszenia danych i elektroniczne przejęcia, ponieważ jest silnie zintegrowany z siecią. W dobie przemysłu 4.0, charakteryzującego się ewolucją robotyki, automatyzacji i Internetu rzeczy, maszyny muszą pracować w trybie współpracy. Sensory, elementy napędowe i kontrolery muszą komunikować się i wymieniać informacje między sobą za pośrednictwem usług chmurowych. Niestety, to sprawia, że stają się one bardzo podatne na ataki cybernetyczne.

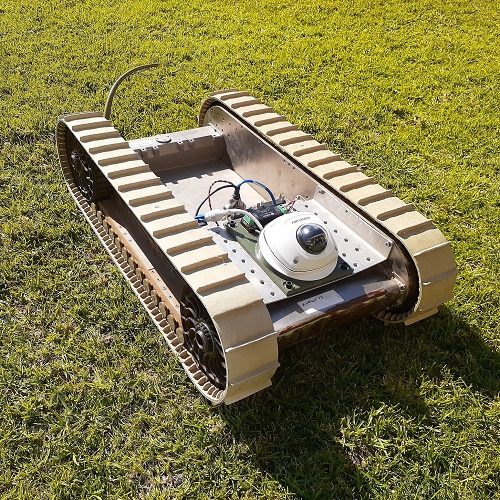

Aby zwalczyć te zagrożenia, naukowcy z uniwersytetu opracowali algorytm AI wykorzystujący techniki uczenia maszynowego. Jego zadaniem jest wykrywanie prób ataków MitM i natychmiastowe zatrzymywanie ich. Przeszedł on rygorystyczne testy na replice pojazdu GVR-BOT, używanego przez amerykańską armię (TARDEC), i osiągnął skuteczność w zapobieganiu atakom na poziomie 99%, przy wystąpieniu fałszywych alarmów w mniej niż 2% przypadków.

Wykrywanie ataków hakerskich na bezzałogowych pojazdach i robotach stanowi ogromne wyzwanie, ponieważ te systemy działają w trybie odpornym na błędy. To sprawia, że rozróżnienie między normalnymi operacjami a sytuacjami awaryjnymi może być trudne. Ponadto, systemy robotyczne mogą być kompromitowane na różnych poziomach, od głównego po jego podsystemy i komponenty, co może prowadzić do poważnych problemów z działaniem robota.

Technologia w akcji

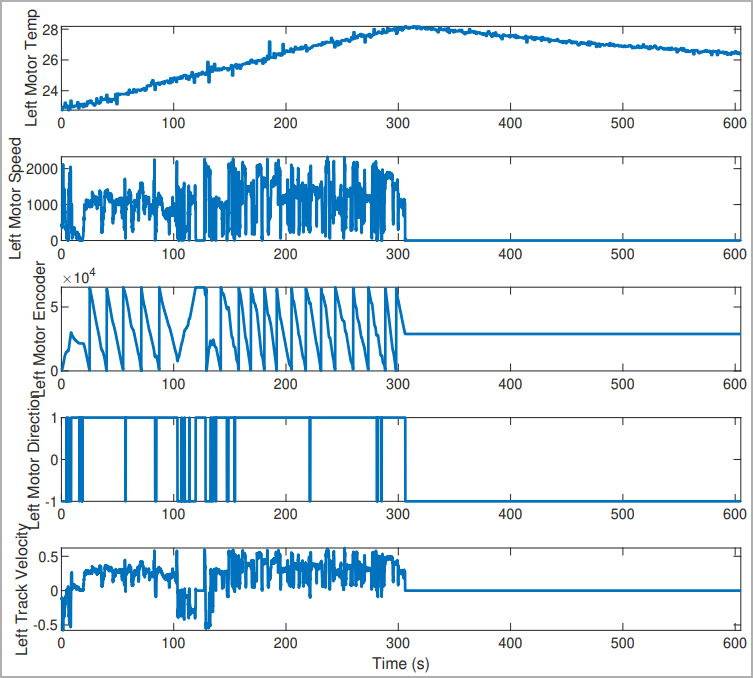

Badacze uniwersyteccy stworzyli oprogramowanie analizujące dane ruchu sieciowego robota w celu wykrywania prób kompromitacji. Ten zaawansowany program AI wykorzystuje metody oparte na węzłach, analizuje dane i korzysta z systemu opartego na statystykach przepływu, który odczytuje metadane z nagłówka pakietu.

Szczegółowy techniczny artykuł opublikowany przez badaczy prezentuje model głębokiego uczenia CNN (konwolucyjnej sieci neuronowej), który został opracowany w tym celu. Składa się on z wielu warstw i filtrów, co podnosi niezawodność wykrywania cyberataków.

Znaczenie dla przyszłości

Rzeczywiste testy przeprowadzone na replice robota z symulowanymi atakami cybernetycznymi skierowanymi na różne systemy wykazały doskonałe wyniki i wysoką dokładność identyfikacji, nawet po zaledwie 2-3 etapach szkolenia modelu. Optymalizowane wersje tego nowatorskiego algorytmu mogą również znaleźć zastosowanie w autonomicznych samolotach.

Dodatkowo planowane jest sprawdzenie skuteczności wykrywania intruzów na różnych platformach robotycznych, takich jak bezzałogowe statki powietrzne, które charakteryzują się znacznie szybszą i bardziej skomplikowaną dynamiką działań w porównaniu do robotów naziemnych.