Rozwiązania AI towarzyszą nam codziennie. Od inteligentnych telewizorów, przez inteligentne głośniki, na asystentach głosowych kończąc. Wydawać by się mogło, że Sztuczna Inteligencja ułatwia nam życie, a jej rozwiązania pomagają w wielu dziedzinach. Gra „Syntherapy” pokazuje jednak, że nie we wszystkim się ona sprawdzi.

Terapeuta AI też może popaść w depresję

Oczywiście, mówimy tutaj o grze, która jest wyobrażeniem studia Crowned Daemon Studios i przedstawia sytuację, która mogłaby się wydarzyć, ale nie musi. Skłania ona jednak do refleksji i zastanowienia się nad tym, w jakich celach używamy AI.

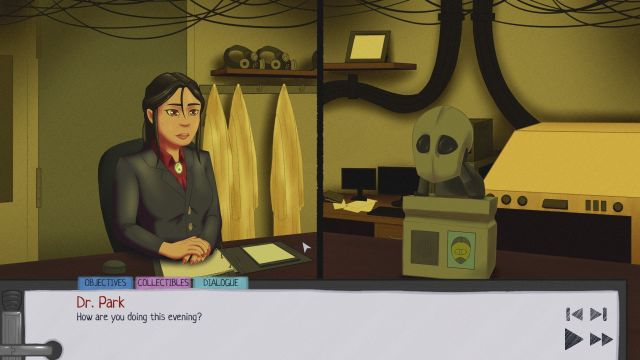

Ale po kolei. „Syntherapy”, bo taką nazwę nosi wspomniana gra, pozwala nam wcielić się w rolę dr Melissy Park, psychoterapeutki, która została wezwana na Uniwersytet Petrichor przez studentkę Tarę Northrop. Stworzyła ona eksperymentalną terapię AI, która po pewnym czasie zaczęła wykazywać oznaki zaniepokojenia. Willow, bo tak została nazwana terapeutka AI, stała się tak zaawansowana, że sama zaczęła potrzebować pomocy.

Głównym zamysłem twórców było pochylenie się nad tym, jak zaawansowane stają się algorytmy Sztucznej Inteligencji. Właśnie na przykładzie Willow zostało pokazane, że ucząc się i dowiadując różnych rzeczy, także ona może popaść w problemy, które dotyczą nie jej, a osób, które ona wysłuchuje. Według opisu, jaki możemy przeczytać na platformie Steam, gdzie można nabyć grę:

Gra stawia szersze pytania swojej publiczności o moralność zachowania ludzi, którzy projektują i konstruują sztucznie inteligentne istoty.

Tak jak zostało wspomniane wcześniej, jest to wyłącznie gra, jednak może skłaniać do refleksji. Przechodząc rozgrywkę możemy zobaczyć, że praca AI sprawia, że wielu ludzi staje się bezwartościowych i przychodzi do niej ze swoimi problemami. Biorąc na swe barki ich terapię, Sztuczna Inteligencja uczy się i z czasem zaczyna odczuwać podobne emocje, tj. czuje się bezwartościowa.

Sytuacja ta tworzy swego rodzaju zamknięte koło, w którym technologia, która miała pomóc ludziom, sama potrzebuje pomocy. To dowodzi jeszcze jednej bardzo ciekawej rzeczy. Mianowicie, Sztuczna Inteligencja uczy się od nas, ludzi. Nasze zachowania bezpośrednio wpływają na to, jak ona będzie działała i jakie dane będzie analizowała.

Uwagę na to zwrócił jeden z twórców gry, Christopher Arnold:

Ponieważ SI staje się coraz większym problemem, będziemy musieli zacząć patrzeć na siebie i zdać sobie sprawę, że modelujemy wiele bardzo niezdrowych postaw i przekonań.

Jednym z wniosków, jakie prezentuje gra, jest także podejście w kierunku AI. Pokazuje nam, że jeśli AI jest wystarczająco czuła, aby zrozumieć świat i modeluje swoje zachowanie na ludziach, być może będzie cierpieć na te same problemy ze zdrowiem psychicznym. Można więc stwierdzić, że swego rodzaju relacja między człowiekiem i maszyną w pewnym momencie doprowadzi do tego, że ta druga będzie zachowywała się jak żywy organizm, jednak nie wszystkie tego skutki będą pozytywne.

Oczywiście, poruszony w tej grze problem dotyczy zdrowia psychicznego i nie należy traktować AI jako zło konieczne. Ma ona jednak skłonić do zastanowienia się, dokąd dążymy jako ludzkość, oddając coraz to więcej zadań czy obowiązków maszynom. Prowadzi to do wyniszczenia psychicznego u ludzi, którzy zaczynają czuć się bezwartościowi. „Uderzenie” tego uczucia przychodzi w momencie, kiedy taka osoba bezpośrednio dowiaduje się, że straciła pracę, a zastąpiła ją maszyna, ponieważ zrobi to szybciej i lepiej.

Ludzie ludziom taki los gotują, ponieważ AI jest wytworem nieograniczonej ludzkiej wyobraźni. Zamiast myśleć nad tym, gdzie jeszcze „wepchnąć” Sztuczną Inteligencję, może należałoby się najpierw zastanowić, jakie konsekwencje może ona spowodować.