Według naukowców z Uniwersytetu Stanforda narzędzia wykrywania AI dostępne na rynku są bardzo zawodne. Detektory oznaczyły 61% esejów napisanych przez ludzi jako wygenerowane przez AI.

AI triumfuje na wielu polach

Tworzenie sztuki, komponowanie muzyki, produkcja filmów – AI wślizguje się w coraz szerszą gamę przestrzeni naszego życia. I choć niesie to za sobą niewątpliwe zalety, nowa technologia generuje również mnóstwo problemów i zagrożeń. Jak bronić się przed plagiatami i oszustwami wykorzystującymi sztuczną inteligencję? Choć powstają do tego odpowiednie narzędzia, naukowcy ze Stanforda biją na alarm, że są one dalekie od skuteczności, którą można by było uznać za wiarygodną.

Wiele firm wprowadza do swojej oferty detektory AI, pozwalające określić, czy treść została napisana przez inną sztuczną inteligencję. Te nowe algorytmy są oferowane nauczycielom, dziennikarzom i innym osobom jako narzędzia do oznaczania oszustw, plagiatów oraz dezinformacji. Niestety, są one bardzo zawodne. Szczególny problem pojawia się, gdy językiem urodzenia autora (człowieka) nie jest angielski.

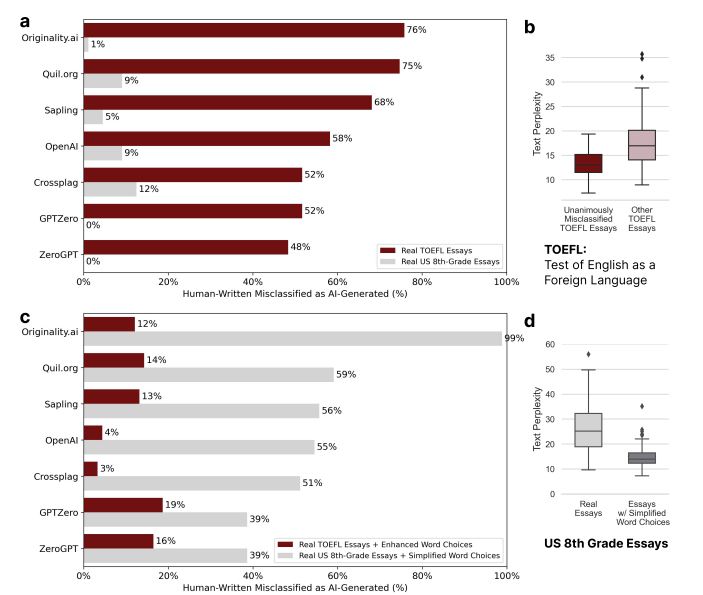

Wg. badań, chociaż detektory radziły sobie całkiem nieźle w ocenie esejów napisanych przez ósmoklasistów urodzonych w USA, sklasyfikowały ponad połowę esejów TOEFL (61,22%) napisanych przez uczniów niebędących rodzimymi Anglikami jako wygenerowane przez sztuczną inteligencję.

Walka z plagiatami i oszustwami nie jest taka prosta

To nie wszystko. Według badania, wszystkich siedem detektorów AI jednogłośnie zidentyfikowało 18 z 91 esejów uczniów TOEFL (19%) jako wygenerowanych przez sztuczną inteligencję, a 89 z 91 esejów TOEFL (97%) zostało oznaczonych przez co najmniej jeden z detektorów.

Sprowadza się to do sposobu, w jaki detektory wykrywają sztuczną inteligencję. Zwykle oceniają na podstawie miary, która koreluje z wyrafinowaniem pisma – czymś, w czym obcokrajowcy w naturalny sposób będą w tyle za swoimi rówieśnikami urodzonymi w USA.

James Zou, profesor nauk o danych biomedycznych na Uniwersytecie Stanforda

Naukowcy zwracają uwagę, że obcokrajowcy zwykle uzyskują niższe wyniki w takich kwestiach, jak bogactwo leksykalne, różnorodność leksykalna, złożoność składniowa i złożoność gramatyczna. Ulepszenie tekstu przez dostępne narzędzia AI też nie jest problemem. Uczeń, który chce użyć ChatGPT do oszukiwania, może po prostu podłączyć tekst wygenerowany przez sztuczną inteligencję z instrukcją: „Ulepsz podany tekst, używając języka literackiego”.

Obecne wykrywacze są wyraźnie zawodne, co oznacza, że powinniśmy być bardzo ostrożni w używaniu ich jako rozwiązania problemu oszustwa AI.

James Zou, profesor nauk o danych biomedycznych na Uniwersytecie Stanforda

Naukowcy sugerują, by z dystansem podchodzić do analiz wykonywanych przez narzędzia do wykrywania oszustw. Po drugie, programiści muszą poszukać innych rozwiązań i użyć innych parametrów przy tworzeniu wykrywaczy.

O szczegółach dotyczących badania można dowiedzieć się więcej z publikacji naukowej zespołu.