Firma Meta AI opracowała nową metodę szkoleniową dla modeli wizyjnych pod nazwą DINOv2. Narzędzie jest już dostępne w wersji interaktywnego demo, a jego zasoby można stosować w trybie open source.

Jak działa model DINOv2?

DINOv2 jest modelem sztucznej inteligencji, który pozwala na dokładne przetransformowanie wizyjne na poziomie obrazu czy wideo. Zadania wizualne są samodzielnie nadzorowane oraz pozwalają na wykonywanie zadań nawet na poziomie pikseli.

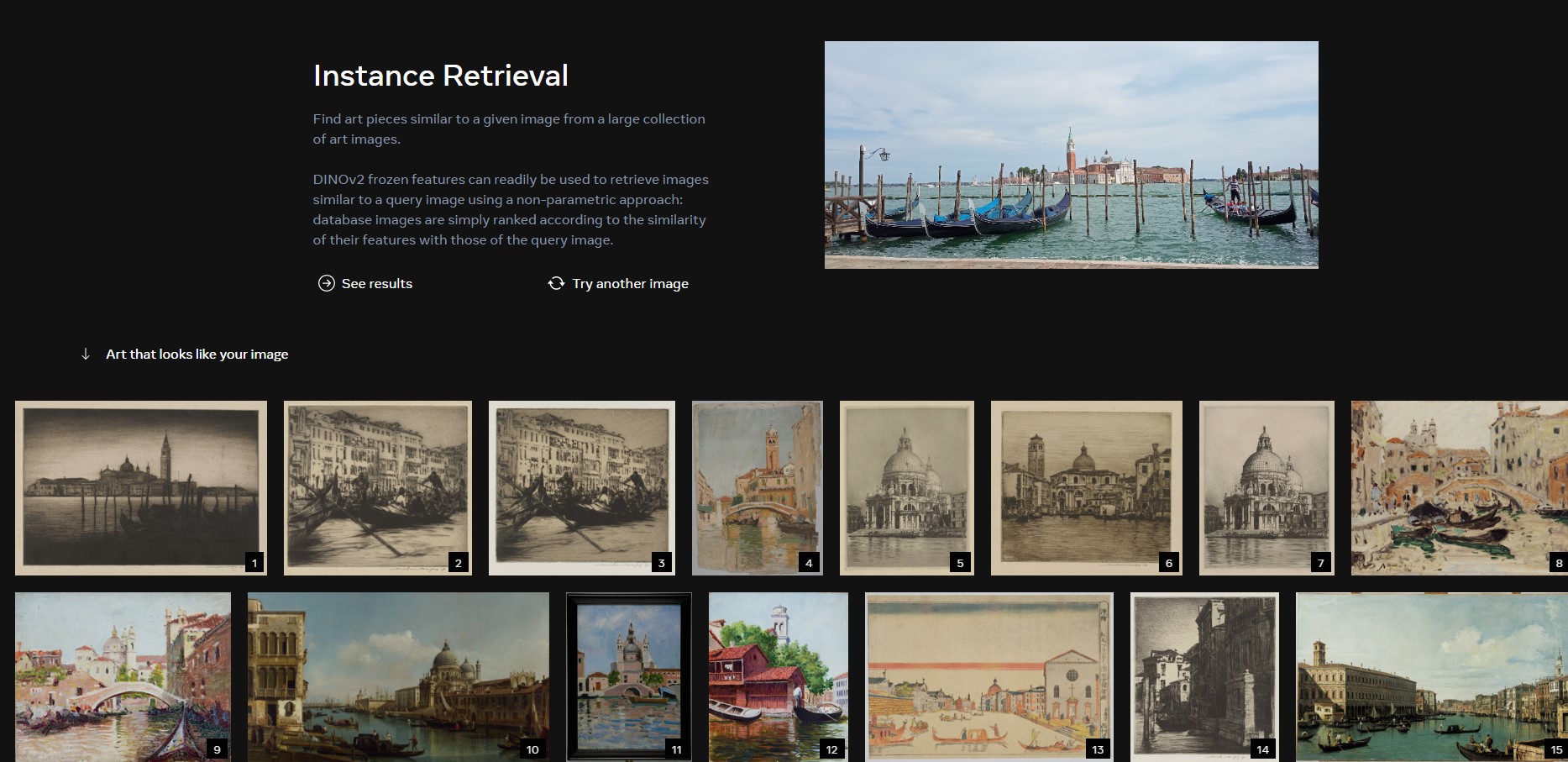

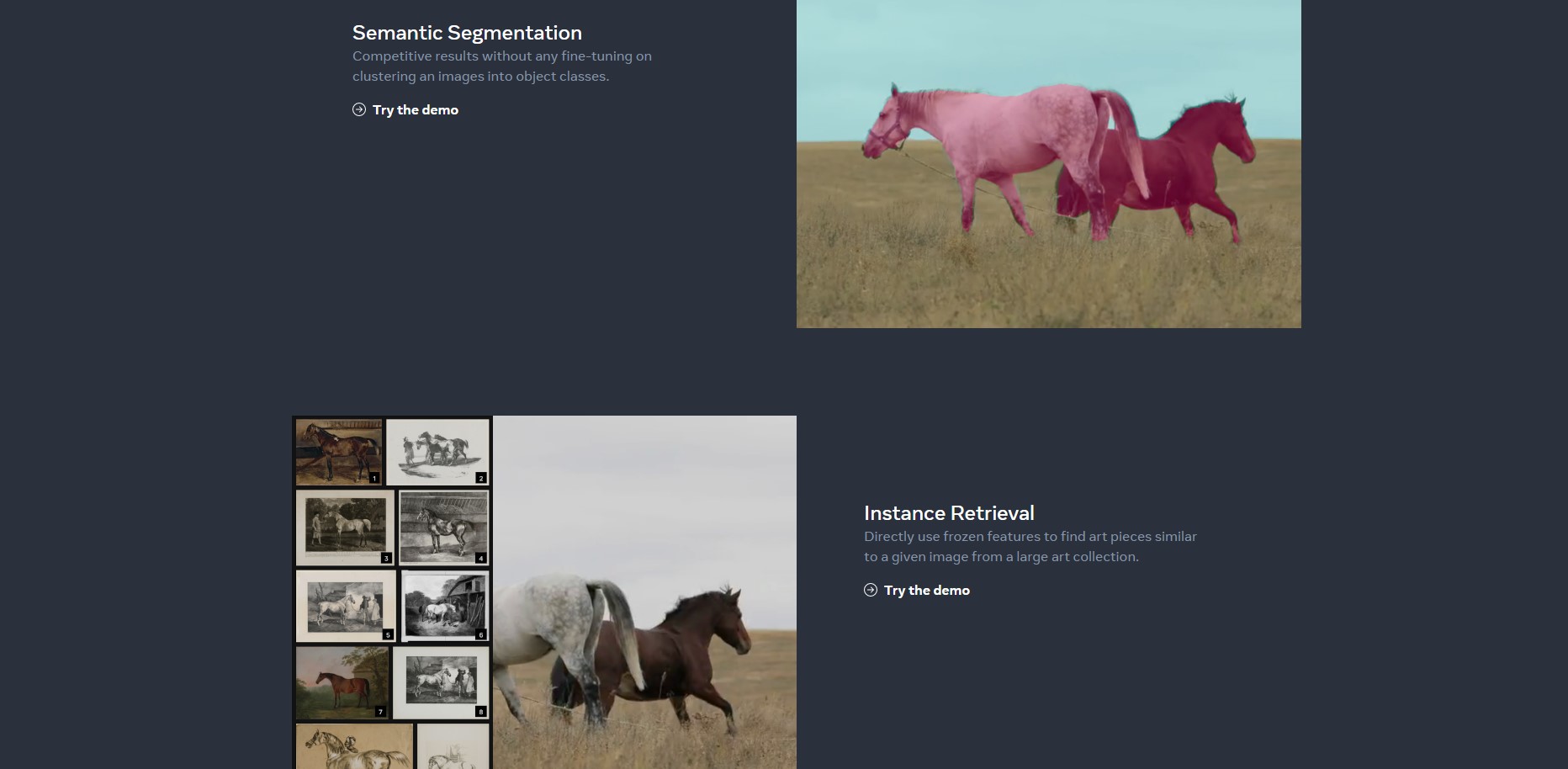

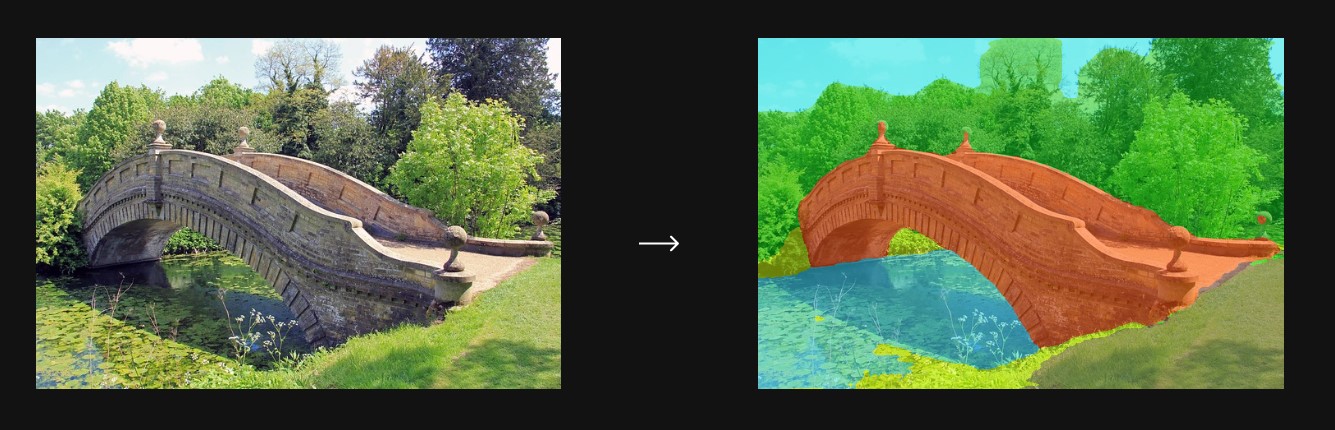

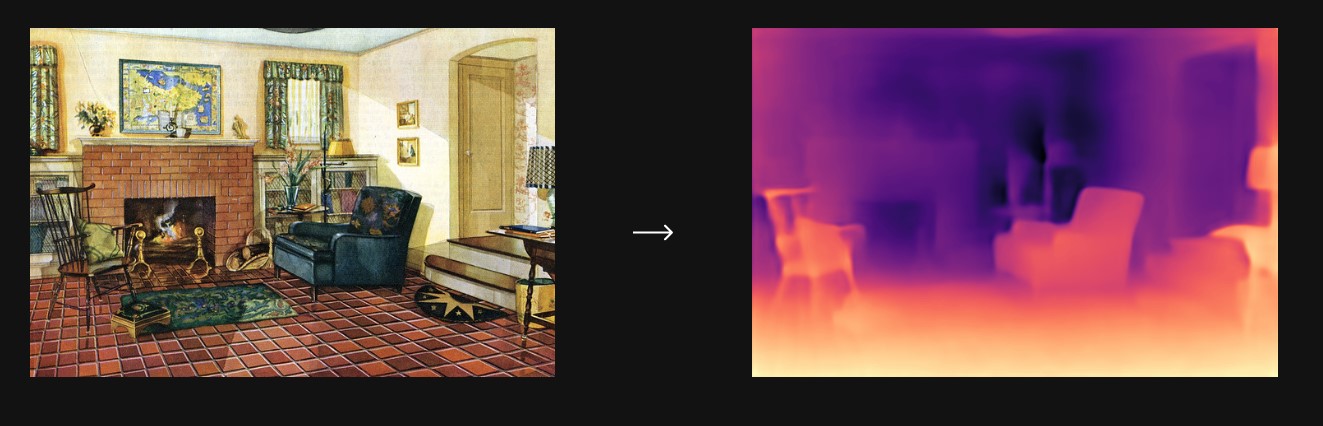

Cechy wizualne wykrywane i tworzone za pośrednictwem DINOv2 wykazują się wysoką jakością i wydajnością oraz nie wymagają dostrajania. Narzędzie to zostało przeszkolone na zbiorze obrazów liczącym ponad 142 miliony pozycji i działa w oparciu o 30 różnych testów porównawczych, które obejmują 8 typów zadań wizualnych. Należą do nich m. in. klasyfikacja obrazu, pobieranie instancji, zrozumienie wideo, szacowanie głębi czy też segmentacja semantyczna.

Głębia, segmentacja i odzyskiwanie instancji

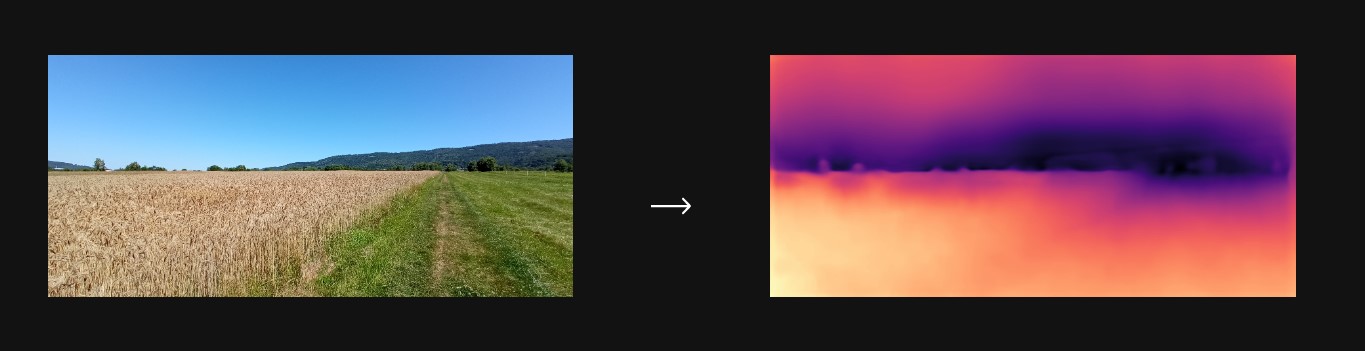

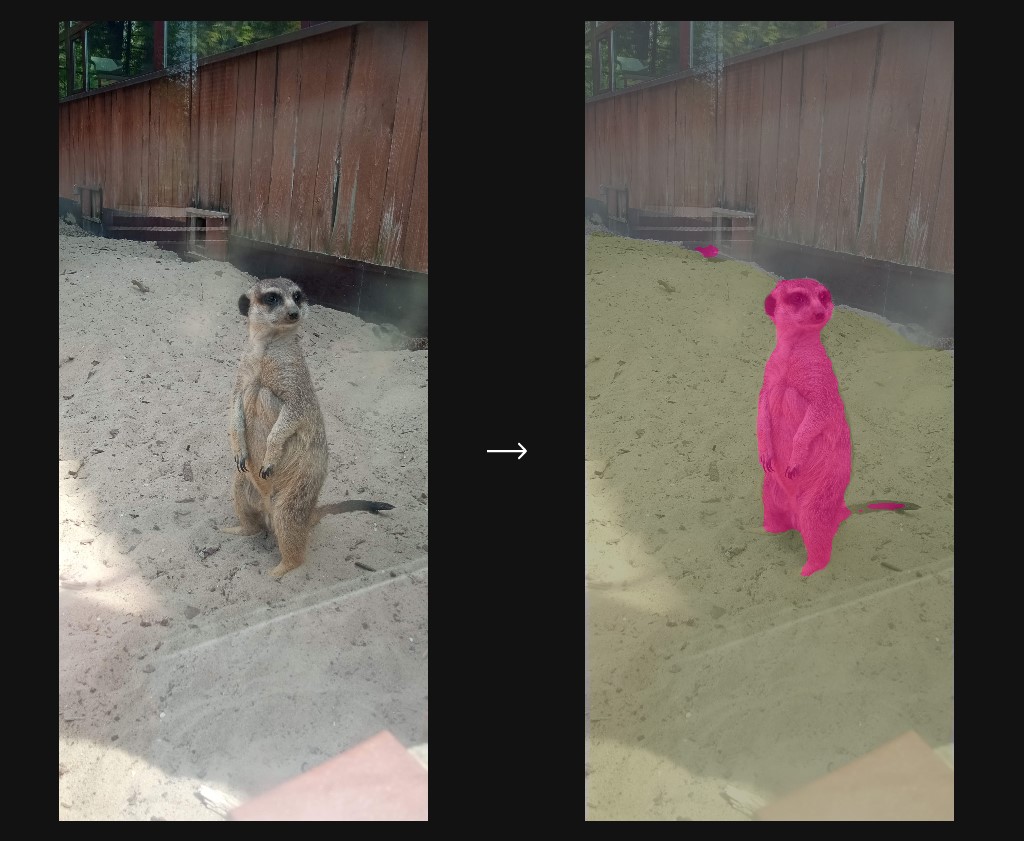

Narzędzie opracowane przez Meta pozwala na oszacowanie głębokości w pikselach każdego, pojedynczego obrazu. Za pomocą wyłącznie modelu liniowego możliwe jest uzyskanie wysokiej wydajności NYU Depth oraz SUN RGB-D, a dalsza poprawa wyników może prowadzić do osiągnięcia lepszej wydajności bez dostrajania. Dzięki segmentacji semantycznej możliwe jest także przewidywanie poszczególnych obiektów na pojedynczych obrazach. Natomiast stosując odzyskiwanie instancji użytkownik może odnaleźć podobne do danego obrazu dzieła sztuki, które ulokowane zostały w obszernej kolekcji. Wypróbowałam wszystkie opcje, efekty poniżej, wygląda to naprawdę nieźle.

Oszacowanie głębokości postanowiłam sprawdzić na zdjęciu pól. Jak widać, faktycznie to, co jest najbliżej zostało dobrze oszacowane. Góry w tle natomiast są najciemniejsze, najbardziej oddalone.

Z kolei opcję segmentacji semantycznej wypróbowałam na przykładzie zdjęcia zwierzęcia. W tym przypadku była to surykatka. Dodatkowym utrudnieniem dla modelu mogłoby być rozpoznawanie zdjęcia zza szyby, jednak i z tym dał sobie radę.

Ostatnia opcja, czyli odzyskiwanie instancji, pozwoliła mi na wyszukanie dzieł sztuki, które pokazują uroki Wenecji. Jak widać i w tym przypadku model podołał swojemu zadaniu.